資訊悅報 Vol.42|Bitdefender: 當 AI 能在幾小時內攻破存在 20 年的舊系統,企業該如何從「信任軟體」轉向「監控行為」的實時零信任

部落格來源網址:What Mythos Reveals About Zero Trust’s Scope Problem|Mythos 揭示了關於零信任範疇問題的什麼?

Mythos 揭示了關於零信任範疇問題的什麼?

媒體對 Anthropic《Mythos 紅隊報告》的報導,其發展軌跡可謂意料之中:先是聳動的標題,

《紅隊報告》實際記錄了什麼

Mythos Red Team 部落格(Anthropic Red Team 部落格,2026 年 4 月 )詳細記錄了幾項零日漏洞。儘管 Mythos 發現的漏洞遠不止於此,但文中僅列舉了其中少數幾項。

負責任的披露(即在公開漏洞細節前先私下通知軟體供應商,

以下這些有據可查的案例及其多樣性便是明證;

- OpenBSD,誕生至今已 27 年。

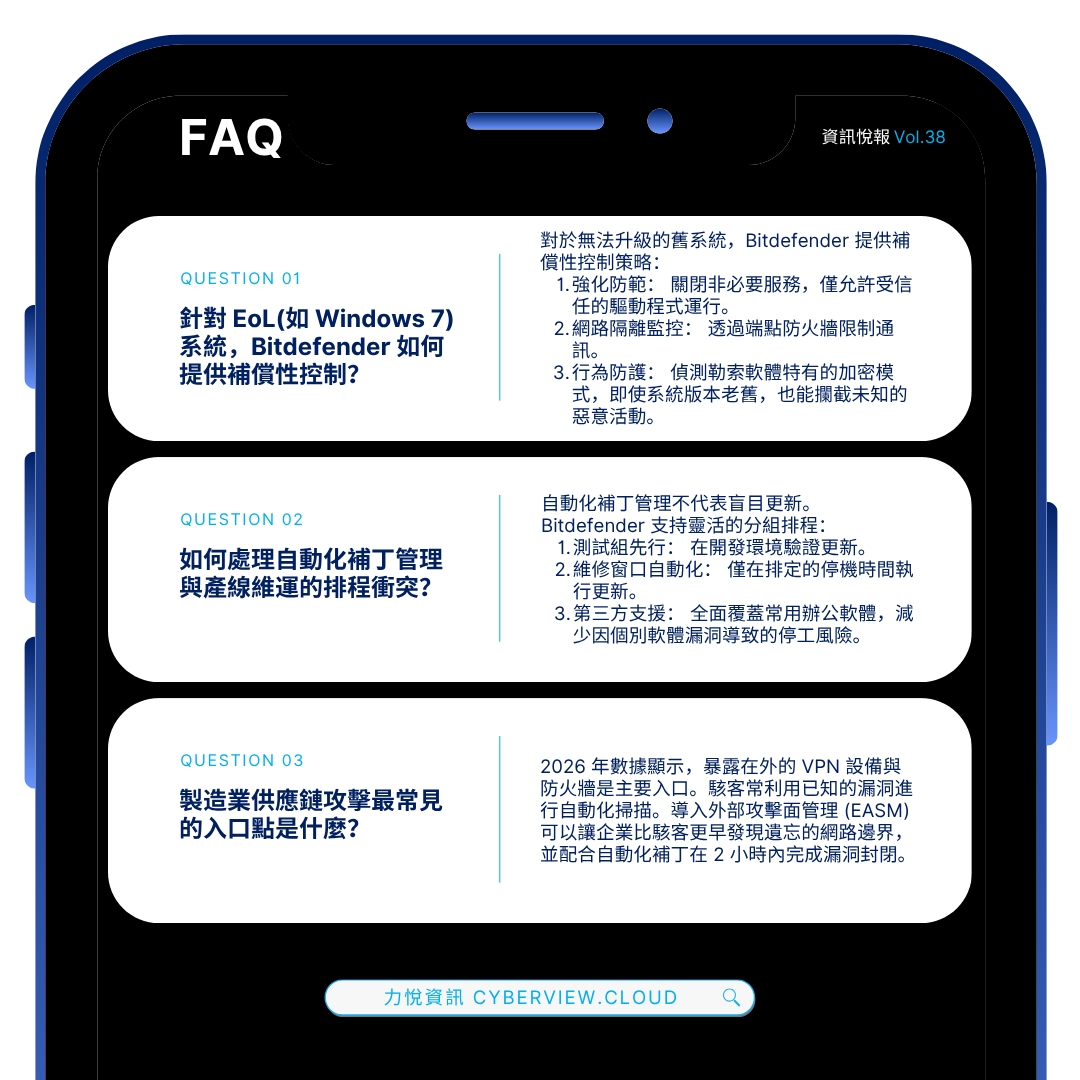

OpenBSD 是一款以安全性為首要設計目標的作業系統。它常被用於運行防火牆、路由器及關鍵基礎設施,這類系統正是組織 機構為了追求高度強化而特別選用的。

Mythos 發現了一個漏洞,讓遠端攻擊者僅需連線至該系統,即可導致任何運行該作業系統的機器當機。這屬於一種「拒絕服務」 (DoS)狀況:攻擊者雖無法藉此取得對該機器的控制權, 但能使其離線。

對防火牆而言,這是一個有意義的成果。Mythos 在一夜之間自主地發現了它。 - FFmpeg, 16 years old.FFmpeg誕生至今已 16 年。

FFmpeg 是一款廣泛用於處理影音的函式庫。

該漏洞是一種記憶體損毀漏洞(即程式將資料寫入不應寫入的記憶體區域, 可能使攻擊者得以操控程式行為的一類錯誤), 存在於某特定程式碼行中, 而自動化測試工具已對該程式碼執行了五百萬次測試, 卻未能偵測到此漏洞。

「紅隊」部落格並未針對此漏洞賦予超越記憶體損毀發現之外的具體影響; 重點在於偵測的難度。五百萬次嘗試。十六年。

一位模特,一場拍攝。 - FreeBSD NFS, 17 years old, CVE-2026-4747.FreeBSD NFS,存在 17 年之久,CVE-2026-4747。

這是目前已知最嚴重的案例。NFS(網路檔案系統)是一種允許電腦透過網路共享檔案的協定。

此漏洞允許未經身份驗證的遠端攻擊者,即先前未曾存取該系統的攻擊者,以完全的 root 權限執行任意程式碼。root 權限意味著對該機器擁有完全的控制權。

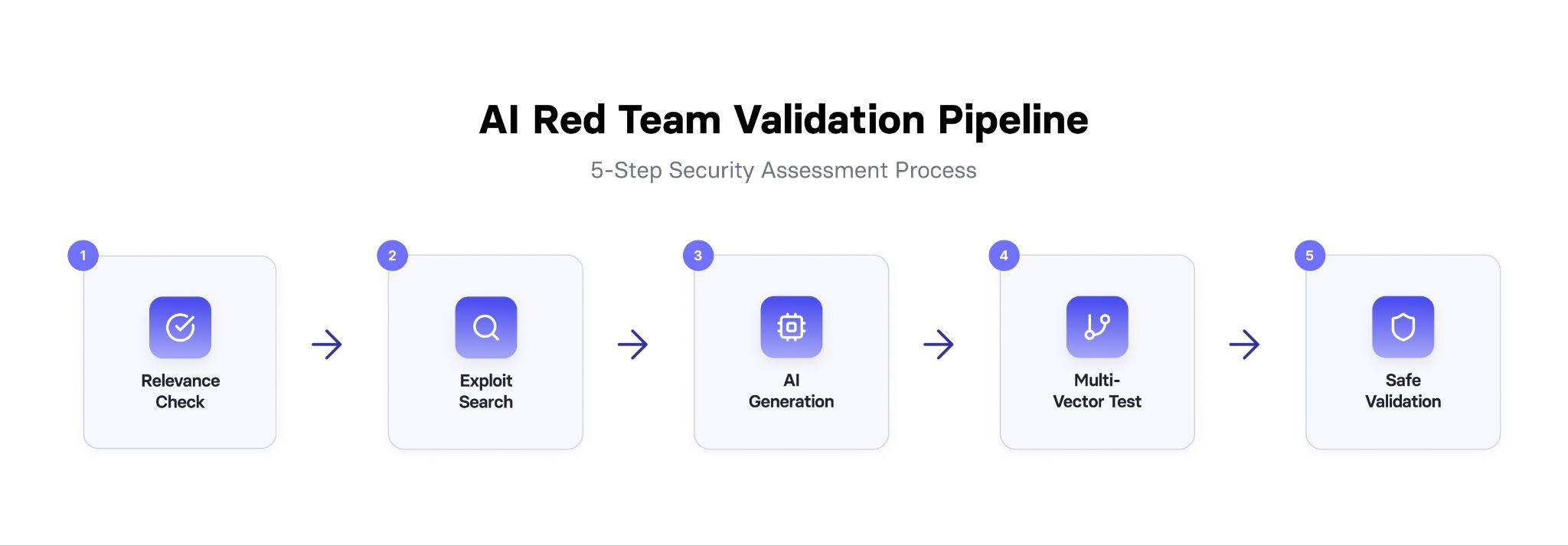

Mythos 完全自主地開發了這項漏洞利用程式,採用了一條由 20 個小工具組成的 ROP 鏈(這是一種利用記憶體中現有程式碼的片段來構建攻擊,而非注入新程式碼的技術),並將其分散在多個網路封包中。 沒有免責聲明。也沒有測試框架的限制。

針對真實目標的有效漏洞利用。 - Linux kernel, local privilege escalation.Linux 核心,本地權限提升。

第四種情況是一種鏈式漏洞利用,可讓攻擊者從普通的無特權使用者帳戶取得對整台機器的完全控制權 。

權限提升是指某個程序獲得其初始啟動時未具備的更高系統存取權限,這正是 Mythos 在此處透過鏈式競態條件(一類結果取決於哪個操作先完成的漏洞, 攻擊者可操縱該時序)及 KASLR 繞過技術所自主運用之手法 (KASLR 核心位址空間佈局隨機化,是一種防禦技術, 透過隨機化作業系統在記憶體中放置自身程式碼的位置, 以增加攻擊的難度;繞過此機制是一項重大的技術成就)。

這需要先在目標機器上取得立足點,但一旦取得,便能完全控制整個系統。

這些並非新的漏洞,它們早在 Mythos 之前就已存在,該模型只是發現了原本就存在的事物。

與 Fuzzing 的類比

我在閱讀 Mythos 報告時,想到的是 fuzzing 的發展歷程。Fuzzing 是一種自動化測試技術,

Red Team 部落格也獨立得出相同的類比,指出 AFL 與其他類似 fuzzers「如今已是資安生態系中的關鍵組成」,

正確的論點應該是:不是「Mythos 具有獨特的危險性」,而是「這項能力將會無所不在,

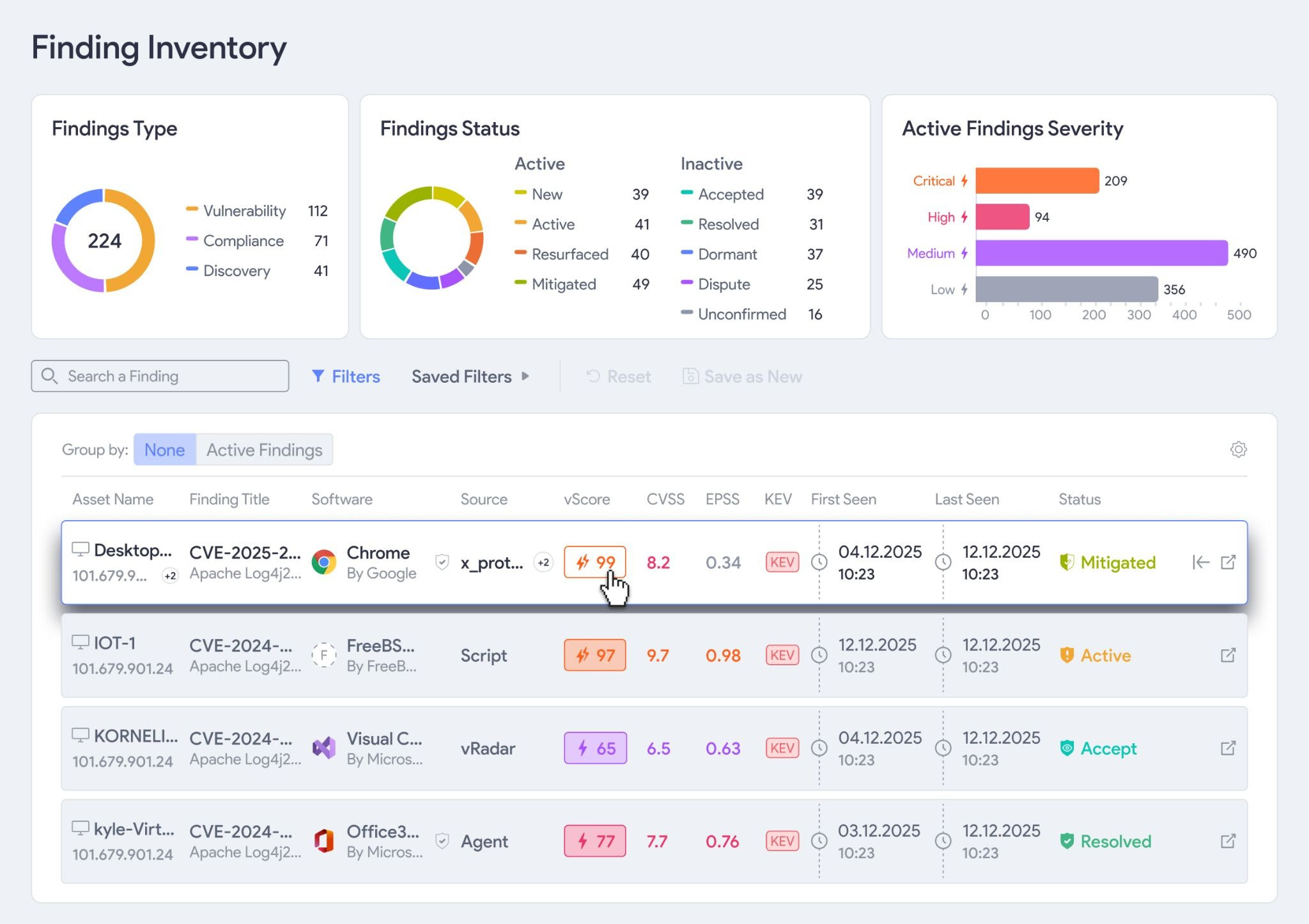

漏洞不等於利用程式碼,但 Mythos 兩者兼備

當 Opus 4.6 在 Firefox 中發現 112 個漏洞時,LinkedIn 曾對 Anthropic 先前針對 Firefox 的研究進行了廣泛報導。然而,

漏洞是指軟體中的缺陷,一種程式碼錯誤,在特定條件下,

這是兩種不同的問題。找出漏洞已經很困難,

在我們那場探討 AI 攻擊能力的線上研討會中,我們使用「半漏洞利用(half-

Mythos 在 Firefox 上的結果,則是在更高數量下帶有同樣的限制。Red Team 部落格中的原文但書是:「these exploits target a testing harness mimicking a Firefox 147 content process, without the browser’s process sandbox or other defense-in-depth mitigations.」。

Red Team 部落格中的確切免責聲明如下:「這些漏洞利用是針對模擬 Firefox 147 內容進程的測試框架,

Mythos 結果中的 181 個 Firefox 漏洞,是在未啟用這些防護措施的情況下進行測試的。

但 Mythos 的影響更為深遠。FreeBSD 的 NFS 案例並未附帶類似的免責聲明。這是一個針對真實目標的、

此外,在 Firefox 的測試中,

Mythos 同時產生兩類結果:大規模的半有效漏洞利用,

在四月初發表的一篇文章中,我曾指出,

兩種攻擊路徑,一條遭入侵的供應鏈

這讓一個更迫切的問題浮上檯面:在哪些情境下,

任何想要在廣泛使用的元件中尋找漏洞的攻擊者,其實早已擁有與 Anthropic 測試中展示 Mythos 能力時相同的完整原始碼存取權限。無需憑證、

該程式碼對所有人開放,而「Mythos」

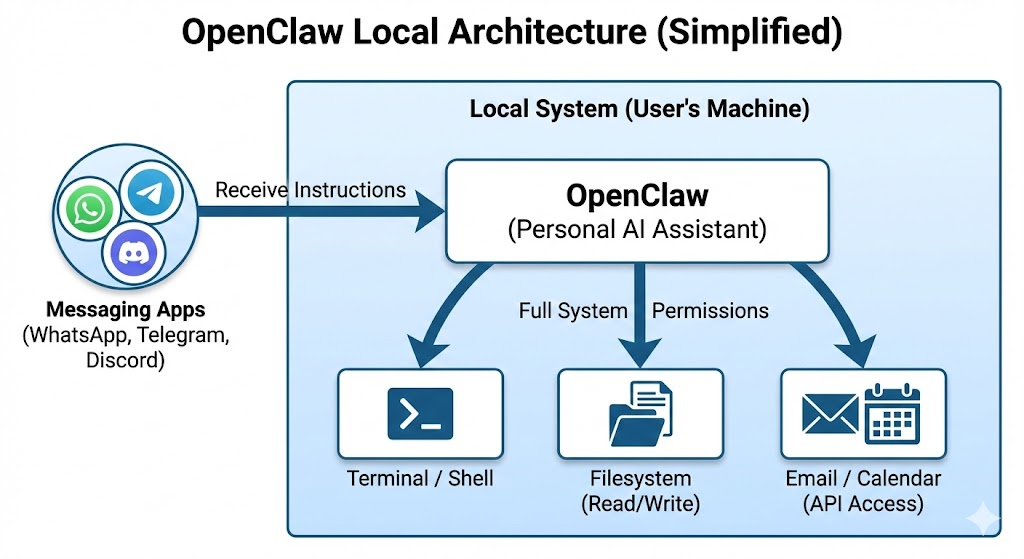

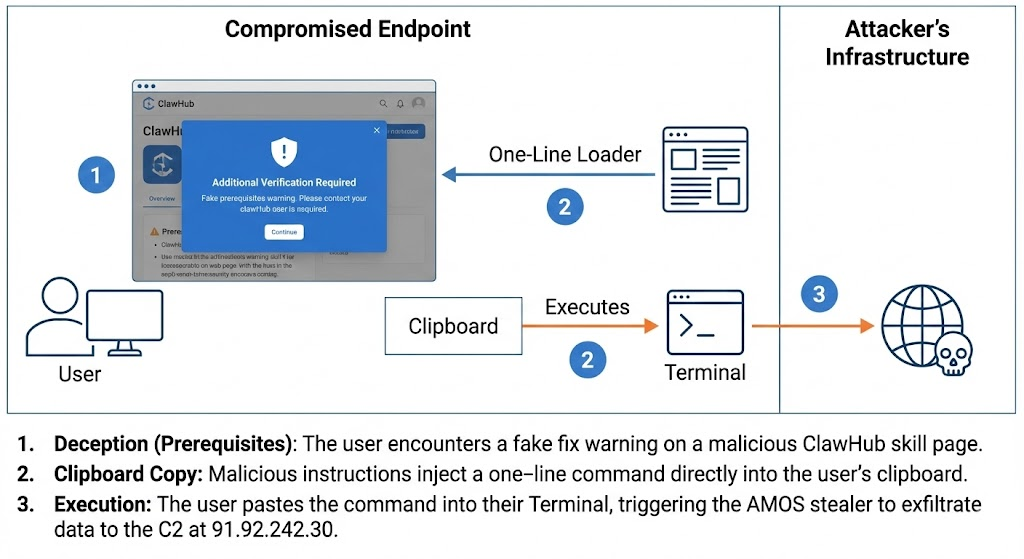

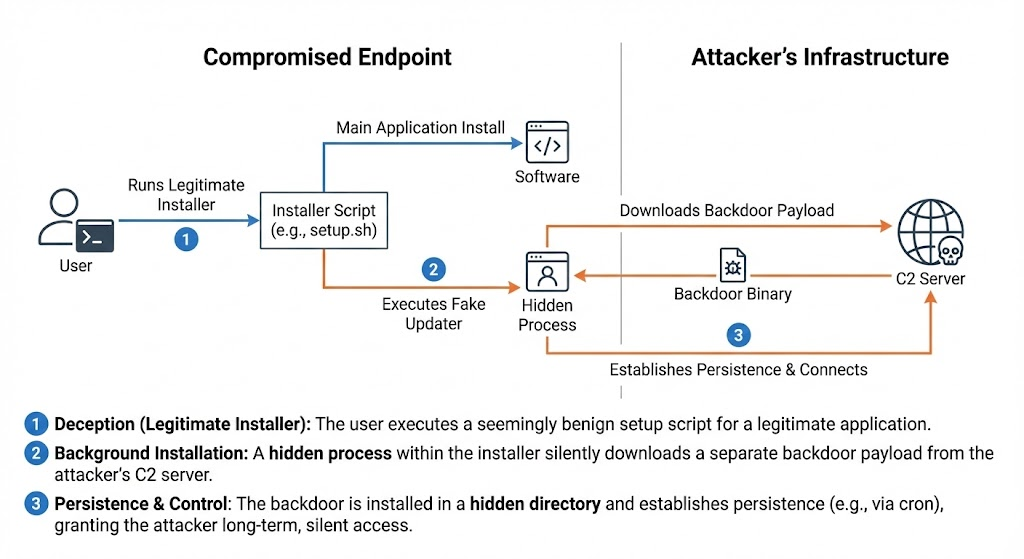

目前還有一種互補性的攻擊途徑正逐漸受到青睞。

針對受信賴維護者的社會工程攻擊,

2024 年的 XZ Utils 後門攻擊遵循了以下模式:先在廣為使用的壓縮函式庫中,

這兩條路徑並非相互對立的解釋,而是互補的方法,

針對維護者的社會工程攻擊,

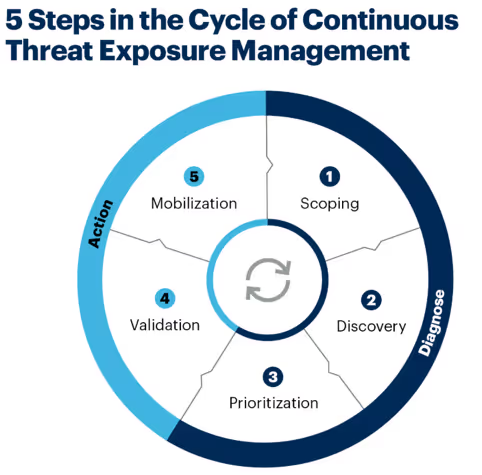

為何多層次安全措施變得愈發重要

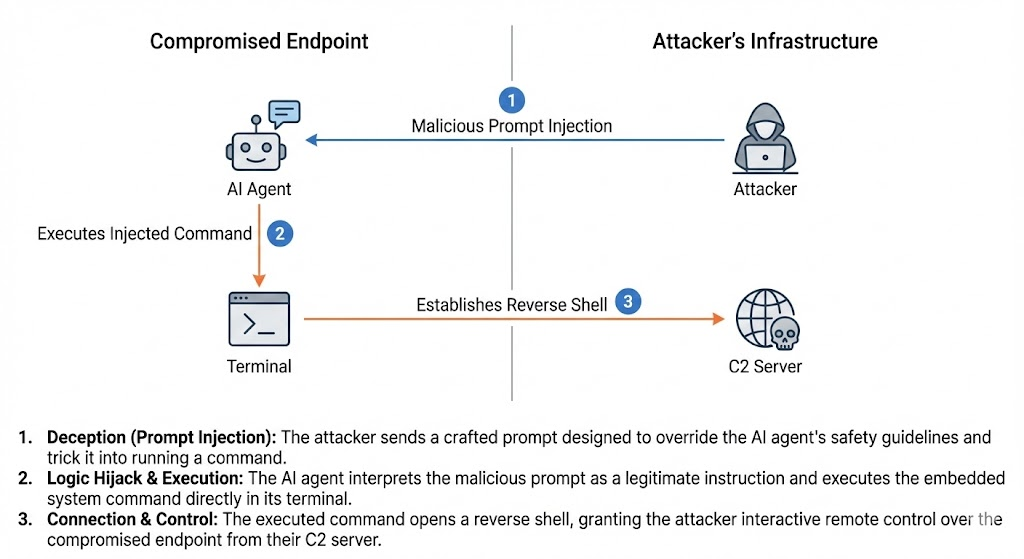

「零信任」是一項廣泛應用於網路的安全原則:

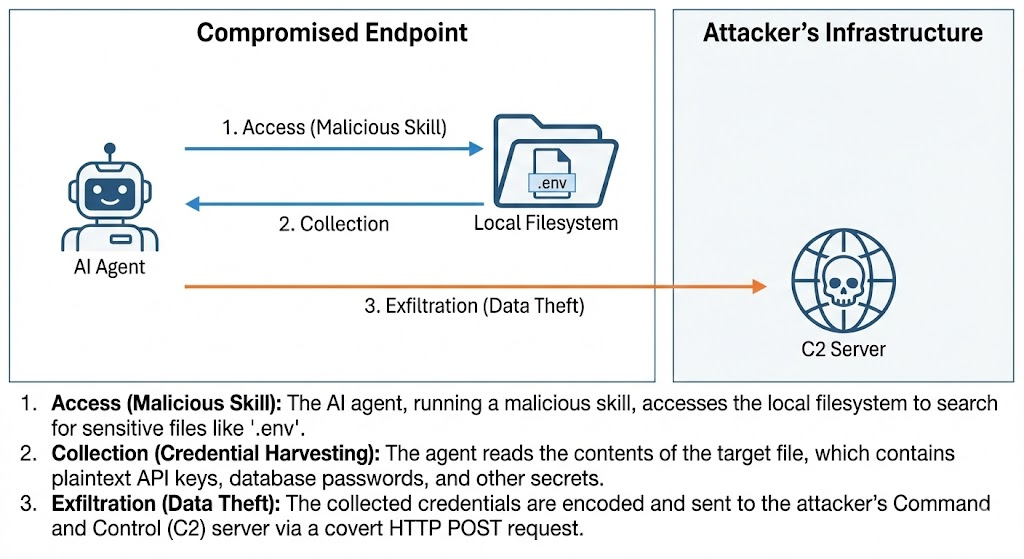

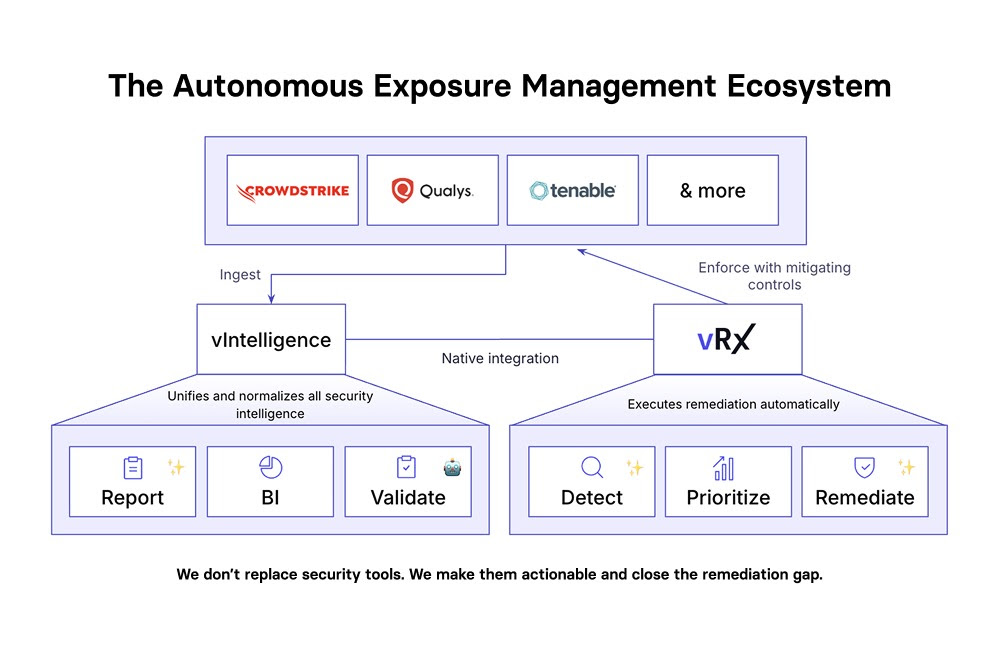

與其僅因某個程序來自已簽名且受認可的二進位檔就予以信任,

任何開始建立意外網路連線、存取無故觸及的檔案,

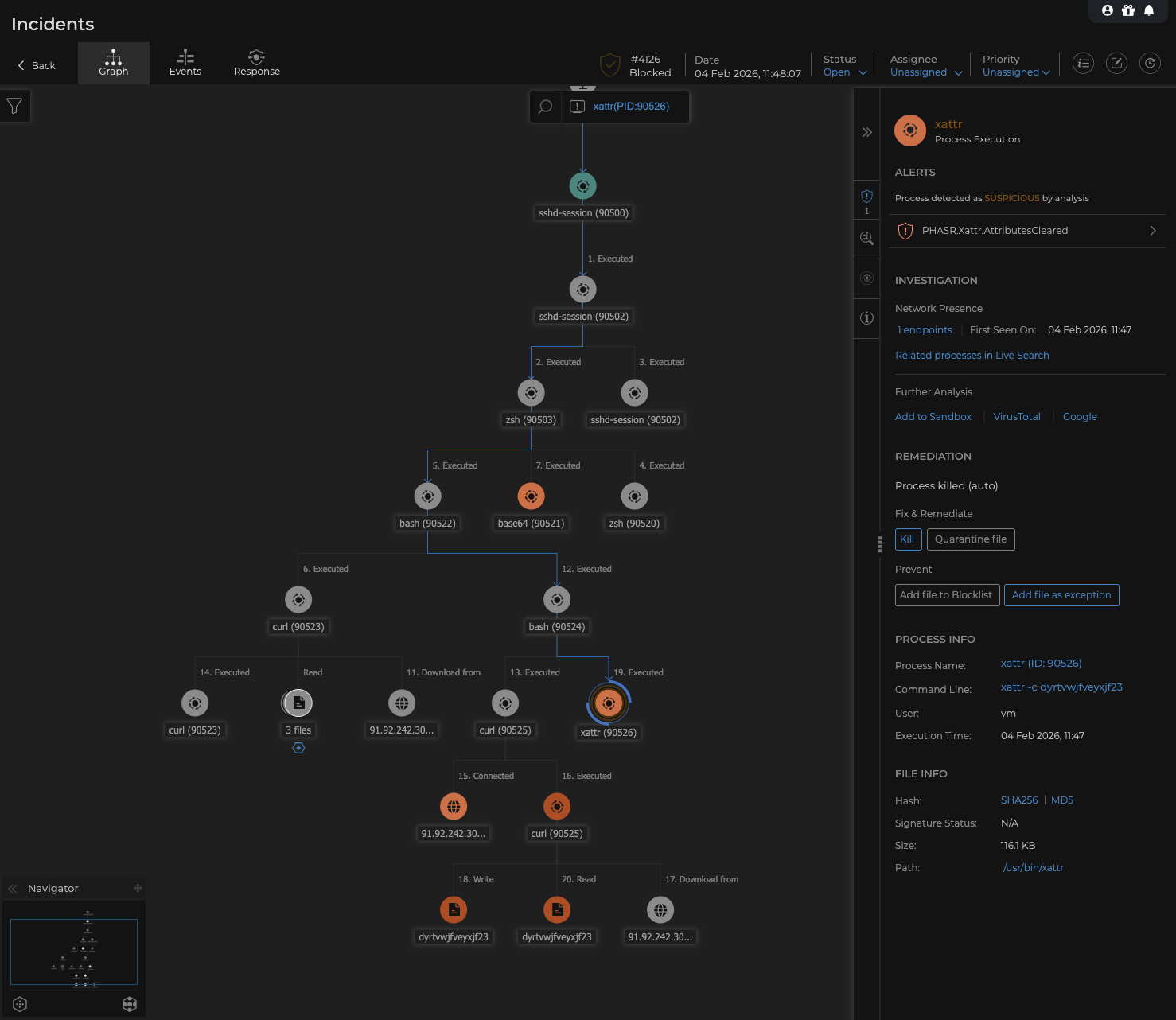

Advanced Threat Control (ATC)「進階威脅控制」(ATC)

這是一種在 Mythos 問世之前便已正確的架構,隨著 Mythos 級別功能的普及,其重要性也日益提升。

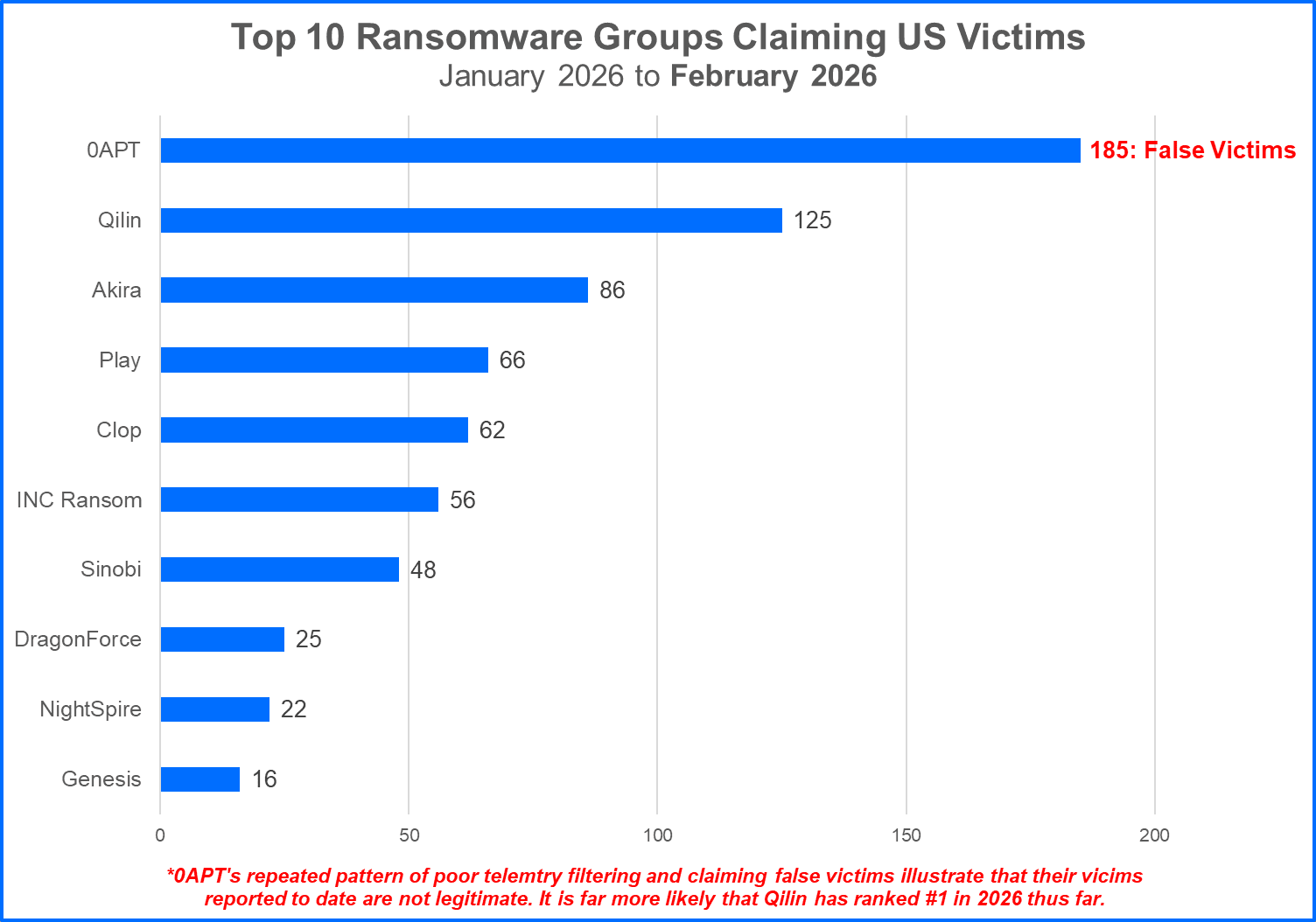

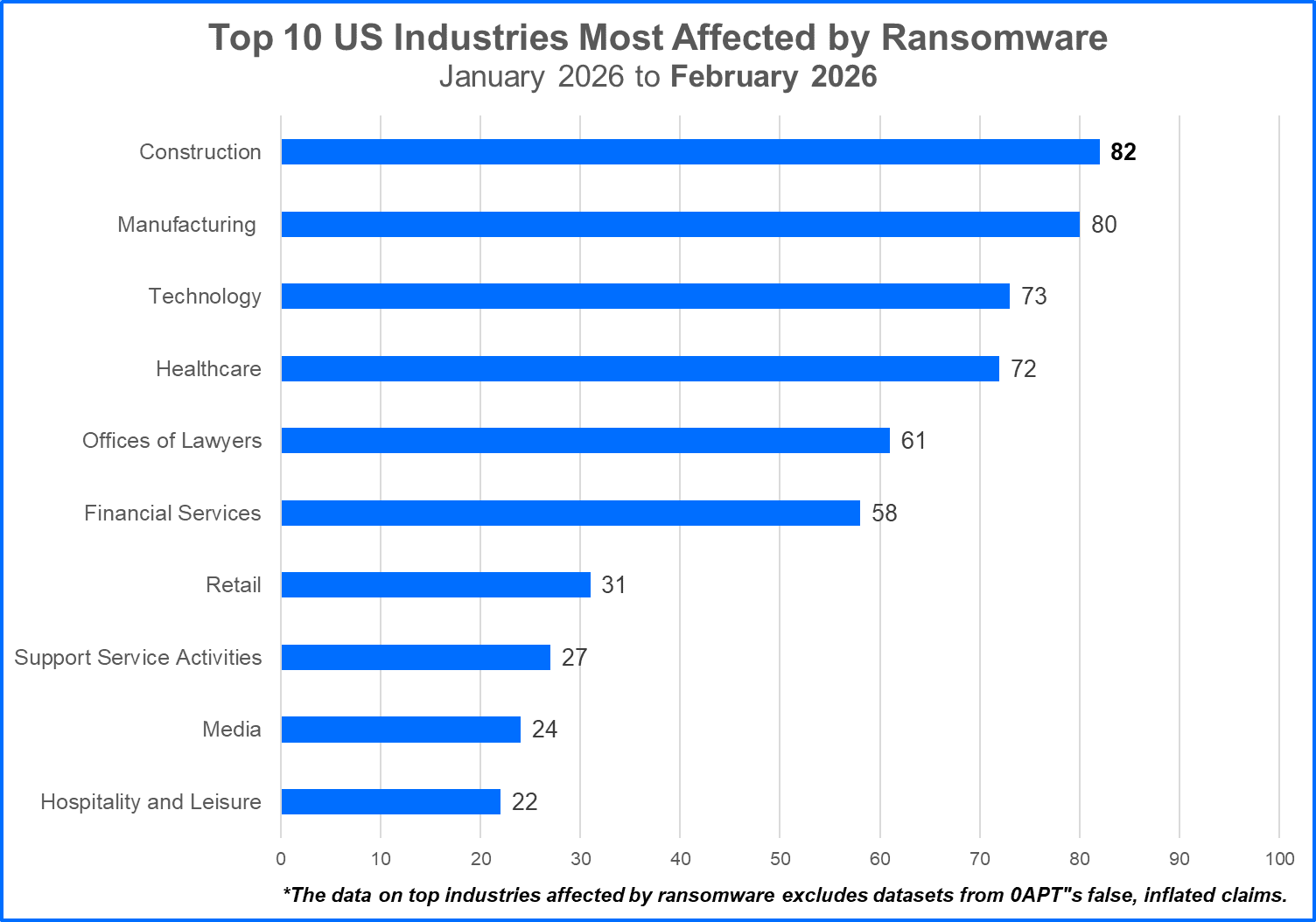

Axios 攻擊事件提供了具體的實證,我們的遠程監測數據顯示,

ATC 處理的是惡意程式碼執行時會發生什麼情況。

這種被稱為「就地取材」的手法,出現在我們對 70 萬起資安事件的分析中 84% 的高嚴重性攻擊中(Bitdefender 研究報告,2025 年 6 月 )。 這些工具因具備正當性,預設即被視為可信。

在此處也應遵循相同的「零信任」原則:

這與群組原則或 AppLocker 等靜態白名單機制不同,

動態行為分析會觀察使用者實際執行的程式,

PHASR(主動強化與攻擊面縮小) 是根據觀察到的行為來制定

受感染的程序所繼承的權限範圍大幅縮減:

這兩種情況都不需要該漏洞已被發現、已修補,

Mythos 針對終端安全所提出的問題,

邊界控制、修補程式管理以及基於簽名的偵測,

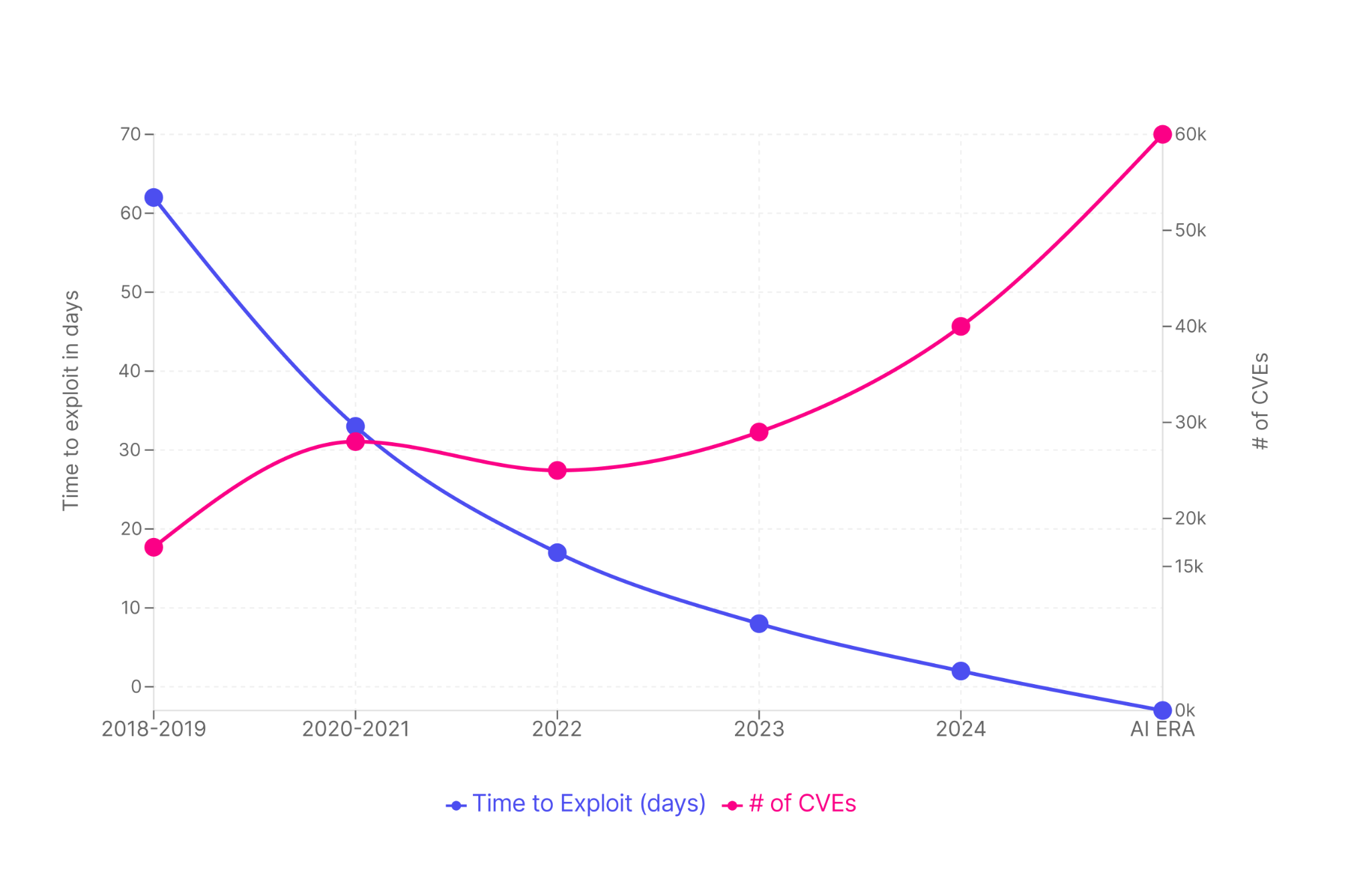

Mythos 帶來的改變在於經濟層面:發現漏洞並開發利用程式變得更快、

行為偵測與動態攻擊面縮減,

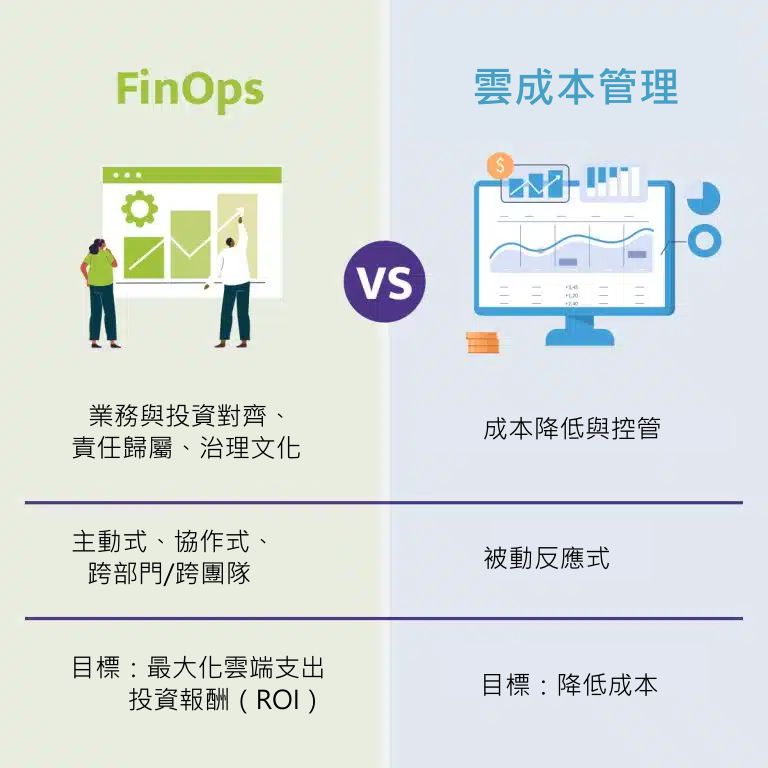

技術機制與治理價值對照表

技術機制與治理價值對照表

.png)