資訊悅報 Vol.44|REFORM REASON: 從「用多少付多少」到預算失真:雲端成本治理的結構性問題

部落格來源:AWS too expensive? 5 AWS Cloud Cost Optimization Tips That Work|AWS 太貴了?5 個實用的 AWS 雲端成本優化技巧

AWS 太貴了嗎?5 個行之有效的 AWS 雲端成本優化技巧

雖然 AWS 推廣人員熱衷於談論成本節省與效率提升,但對許多企業而言,

如果您是受監管的金融機構、醫療保健或保險組織,

如果「雲端更便宜」這句話不適用於您或您的組織,

那麼,為什麼 AWS 會如此昂貴?

毫無疑問,公有雲具備可擴展性、靈活性,且易於導入。

隨用隨付(On-demand)定價難以控管

您是否曾忘記關閉閒置資源?這些成本會迅速累積。一個被遺忘的 EC2 執行個體若運行一個月,可能耗費數百美元;例如,

受監管的行業必須支付額外費用

對於醫療保健、金融、政府及其他受監管產業的企業而言,AWS 不僅價格高昂,往往更是所有選項中成本最高的一項。原因何在?

此外,您還得為無法使用的功能付費。標準的 AWS 服務通常無法直接滿足法規要求。您需要:

- 專用執行個體,其成本是共用基礎架構的 2 至 3 倍。

- 排除經濟實惠選項的私有雲端網路(VPC)設定。

- 資料存放的特定區域,這會限制您選擇更便宜可用區域的能力。

企業的批量折扣已觸及上限

雖然 AWS 提供企業折扣方案,但節省的金額在達到某個門檻後便會趨於平緩。

過度配置成為預設行為

許多團隊會「以防萬一」而預先配置基礎設施。

服務過多會導致複雜性

AWS 提供數百種服務,因此很容易部署功能重疊的工具,

資料外傳(Data egress)成本極高

將資料從 AWS 移出——尤其是跨區域或傳輸至網際網路——

一家提供串流影音內容的媒體公司可能會發現,

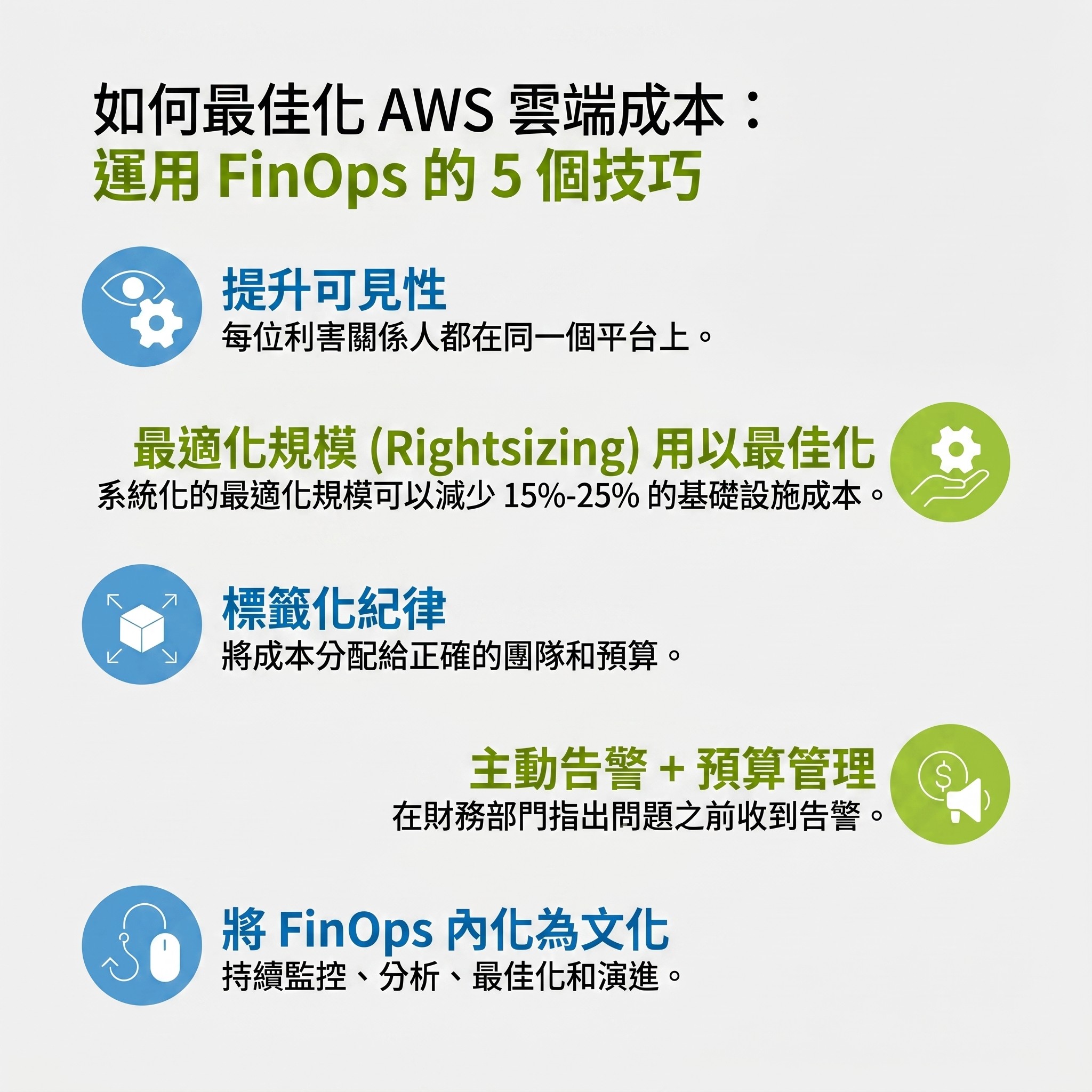

如何優化 AWS 雲端成本:5 個 FinOps 實用技巧

1. 提升能見度

看不見的東西,就無法加以優化。

而 FinOps 的第一步,就是了解雲端環境中實際發生的狀況。

RE:FORM 為您提供橫跨 AWS、Azure、GCP、阿里雲及 Kubernetes 的統一即時儀表板。您無需手動整合各帳戶的資料,

這意味著從工程到財務的每位利害關係人都能達成共識。

2. 資源優化、閒置資源清理及超支警示

大多數 AWS 資源預設皆配置過高。請每月進行資源優化檢視,並找出 CPU 使用率持續偏低、規模過大的資料庫,以及閒置容量過高的儲存卷。

一套系統性的規模優化計畫,通常能在不影響效能的前提下,

對於混合雲或多雲使用者,以及企業營運而言,

RE:FORM 讓您能夠設定基於政策的優化規則,其餘工作則由平台自動處理。

無論是資源規模調整、閒置資源清理,還是預算閾值警示,

3. 實施有系統的標記與成本分攤

針對所有 AWS 資源制定強制性的標籤政策,包括成本中心、專案、

妥善的成本分攤機制能建立費用轉撥模式,使各團隊對其支出負責,

如何在多雲和多環境中統一標籤與成本分攤政策?

更棒的是,部署時的自動標記功能讓工程師能專注於產品發布,

4. 設定主動式預算與警示

越早發現設定錯誤的資源或超支情況,效果越好。

您可以手動設定異常偵測功能,以偵測異常的支出激增。

管理多雲環境時會發生什麼情況?

透過 RE:FORM 的即時警示與趨勢分析,

由於所有資料都會根據服務、地區和團隊進行情境化處理,

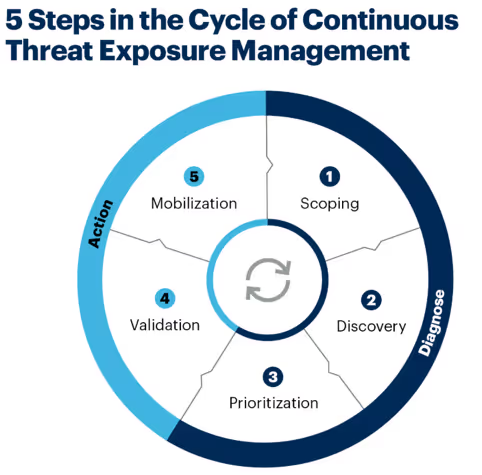

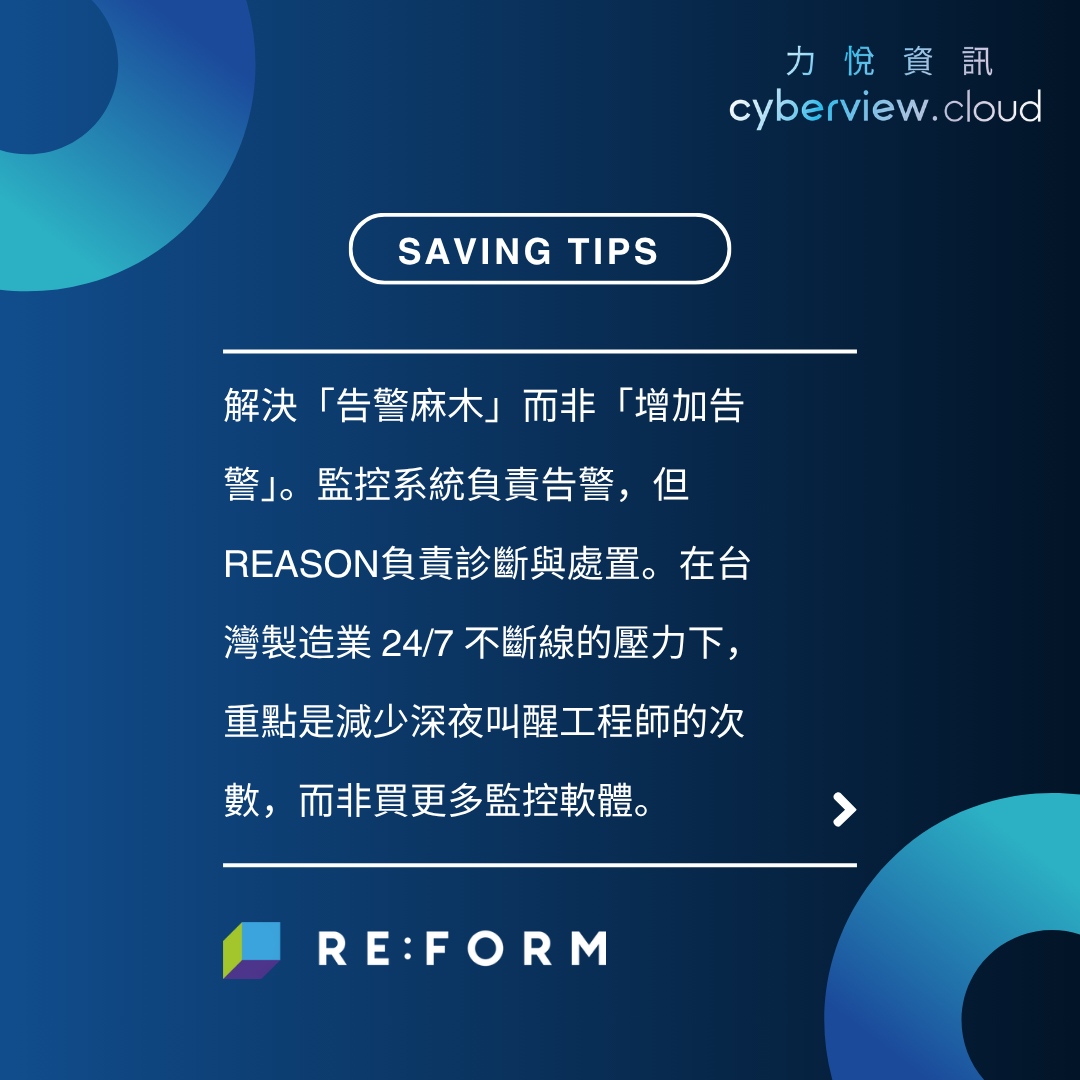

5. 建立企業文化並持續優化

FinOps 致力於營造一種協作環境,讓財務、工程與業務團隊攜手合作,

定期的跨職能審查與成本優化工作坊有助於維持這種協作模式。

請記住,FinOps 並非一次性的解決方案,而是一個持續監控、

透過定期檢視雲端使用狀況,並根據數據驅動的洞察進行調整,

利用 RATE 優化並重新調整雲端支出

別只顧著尋找折扣雲端方案和節省開支;

上述 5 項做法是您展開雲端成本優化之旅的簡易起點。

但雲端優化並非一次性專案,而是一項持續進行的工作。

您需要一套經濟實惠、可靠且全面的 FinOps 解決方案來承擔這項艱鉅任務。

RATE 專為協助雲端支出龐大的組織解決這些具體挑戰而設計:

- 重新掌握掌控權 透過單一儀表板,全面掌握 AWS、Azure、GCP 和 AliCloud 的多雲端可視性

- 透過服務供應商專屬建議所產生的執行方案來優化支出

- 安心無憂 免去因標籤混亂與成本驟升所造成的雲端混亂

- 同時提供雲原生資源與 Kubernetes 支援

我們的客戶通常能在 30 天內找出 25% 的即時成本削減機會,同時強化治理與問責機制。

準備好讓您的雲端預算與企業願景保持一致了嗎?

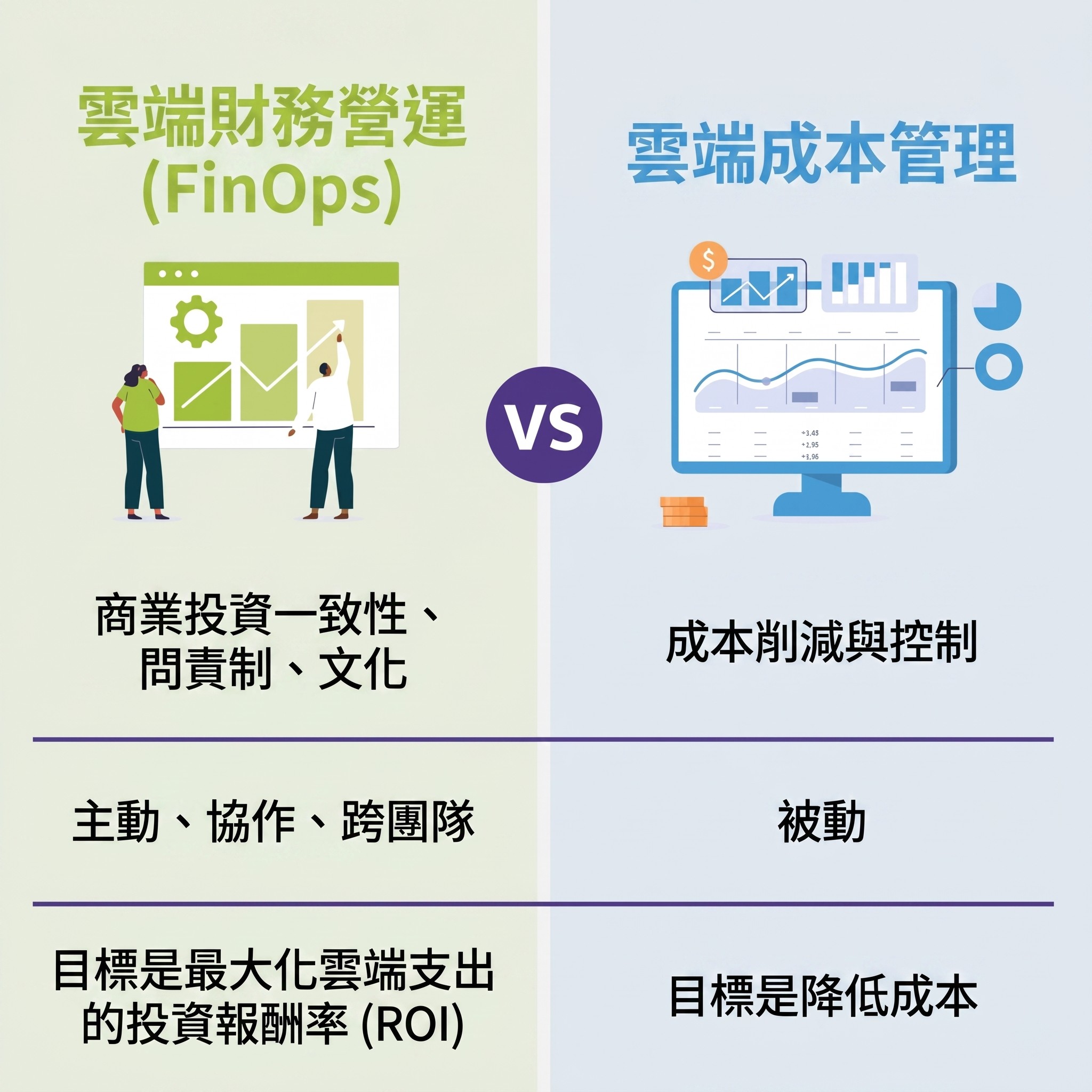

技術機制與治理價值對照表

技術機制與治理價值對照表

.png)